Voix clonées, morceaux dopés par des ordinateurs, etc. Cela fait un moment que la révolution de l’intelligence artificielle (IA) touche le monde de la musique. Encore anecdotique il y a quelques années, elle a été au centre de toutes les conversations en 2024.

C’est un peu le rendez-vous pro qui lance l’année musicale. Organisé à Groningen, Eurosonic aura lieu du 15 au 18 janvier prochains. Au programme du festival néerlandais, quelque 350 artistes émergents, venus de toute l’Europe. Mais aussi, à côté des concerts, une centaine de talks, débats, conférences, etc. Et un fil rouge clair: l’intelligence artificielle. La thématique est au centre de pas moins de dix conférences. Preuve, s’il en fallait encore, que l’IA est devenue la nouvelle marotte du music business…

Dans une industrie toujours traumatisée par la bascule digitale des années 2000, l’enjeu est en effet devenu incontournable. Plus question d’essayer de contrecarrer la nouvelle révolution technologique -comme quand, début 2000, les majors passaient leur temps à poursuivre, en vain, les « pirates » et les sites de téléchargement illégaux. Désormais, tout le monde semble d’accord pour accompagner le mouvement. De peur de louper à nouveau le coche.

L’IA est de toute façon déjà partout. Que ce soit dans les algorithmes de recommandation des plateformes de streaming, ou dans les applications de reconnaissance de morceaux, type Shazam. Elle est également de plus en plus utilisée dans le mixage des productions musicales. L’an dernier, la nouvelle d’un morceau inédit des Beatles boosté à l’IA avait par exemple défrayé la chronique. Avec son lot de raccourcis et de confusion. Now and Then n’était en effet pas un morceau généré directement par un robot -à l’instar du pastiche Daddy’s Car, exercice de style « à la manière de », créé en 2016 par la technologie française Flow Machines. Non, si l’IA est bien intervenue sur Now and Then, c’est uniquement pour aider à « dépoussiérer » une ancienne démo de John Lennon et en isoler la voix.

Au milieu des années 90, les Beatles encore vivants -Paul Mc Cartney, George Harrison et Ringo Starr- avaient d’ailleurs déjà travaillé sur le morceau. Mais sans réussir à en tirer grand-chose de convaincant. C’est en voyant le réalisateur Peter Jackson se pencher sur une nouvelle version du documentaire Get Back de 1970, s’appuyant sur l’IA pour séparer les pistes sonores des images de l’époque, que Paul et Ringo ont décidé de retenter le coup.

Dans un autre genre, mais pour les mêmes raisons, la série-documentaire événement DJ Mehdi – Made in France, qui a cartonné cet automne sur Arte.tv, a également fait appel à l’IA. Pour montrer comment le génial producteur a composé ses tubes pour les rappeurs du 113 ou Ideal J, le réalisateur Thibaut de Longeville a voulu inclure plusieurs séquences dans lesquelles les morceaux sont désossés et remontés. Problème: les enregistrements multipistes d’origine n’étaient pas toujours accessibles, certains ayant même parfois disparu. Grâce à l’IA, chaque élément des chansons a cependant pu être identifié et isolé. Le tour était joué.

En Belgique, Daan s’est également amusé avec la technologie. Pas tant pour la composition de son dernier album, intitulé Space, sorti le mois dernier. Mais plutôt pour ses visuels. Le musicien-graphiste flamand s’est servi de l’outil pour concevoir à la fois la pochette de son disque et ses deux derniers clips! Co-réalisées avec Maarten Francq, VJ et professeur au RITCS (Royal Institute for Theatre, Cinema and Sound), les vidéos de Work et Fun ont été réalisées « sans caméras, ni personnages ou décors existants »!

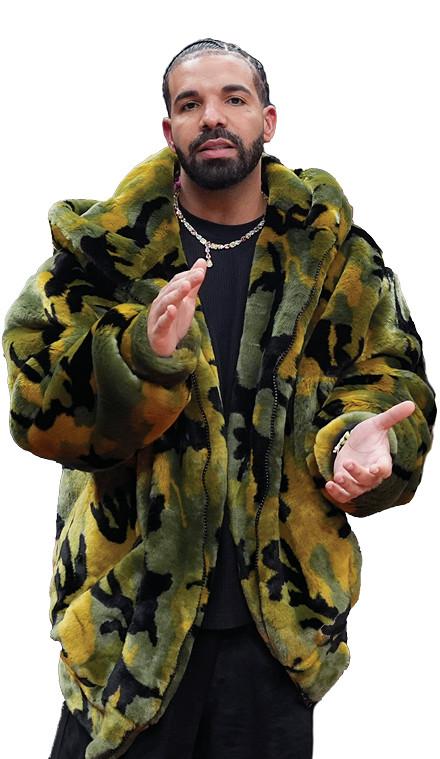

À l’international, une autre utilisation de l’IA a pas mal fait parler d’elle cette année. Dans son clash très médiatisé avec Kendrick Lamar, le rappeur Drake a publié en avril le morceau Taylor Made Freestyle. Un titre sur lequel on pouvait entendre les voix, reproduites par l’IA, de Snoop Dogg et Tupac Shakur. Une galéjade qui a fait rire le premier, mais beaucoup moins les héritiers du second, qui ont exigé (et obtenu) le retrait du morceau…

Elvis is alive

Le plus cocasse dans l’histoire est sans doute que Drake lui-même avait été victime d’un « clonage » pile poil un an auparavant. Au printemps 2023, un certain Ghostwriter977 sortait en effet Heart On My Sleeve, un duo supposé entre le rappeur canadien et son compatriote The Weeknd. Pour beaucoup, l’IA a fait illusion. Au point d’affoler les compteurs sur TikTok et de finir par atterrir sur les plateformes de streaming. La blague n’a toutefois pas séduit tout le monde. Surtout quand le mystérieux producteur a voulu soumettre son titre aux Grammys, les plus grandes récompenses de l’industrie musicale américaine. En théorie, le morceau était en effet éligible -puisque, après tout, il avait bien été écrit par un être humain. Il faudra l’intervention du président de l’Académie Harvey Mason Jr. pour clarifier la situation –non, Heart On My Sleeve ne pourra pas être retenu, à partir du moment où Ghostwriter977, le bien nommé, n’avait pas demandé l’autorisation d’utiliser les timbres de voix des deux artistes. Et un soupir de soulagement de parcourir toute l’industrie musicale…

Car même si le music business n’entend pas rater le train technologique, il se méfie. Du moins ses artistes. Le 2 avril dernier, ils étaient plus de 200 à signer une tribune, demandant de mieux protéger leurs créations contre les dérives de l’IA. Parmi les signataires, des stars comme Billie Eilish, Katy Perry, R.E.M., Nicki Minaj, J Balvin, Stevie Wonder, etc. Pas question de condamner la technologie en soi, insistent les musiciens dans leur lettre ouverte, mais « nous devons nous protéger contre une utilisation prédatrice de l’IA pour voler les voix et les ressemblances des artistes professionnels, violer les droits des créateurs et détruire l’écosystème de la musique ».

Le politique lui-même n’est pas complètement insensible à la question. Aux États-Unis, le Tennessee a été le premier, en mars dernier, à adopter une loi en la matière. Avec son « ELVIS Act » (pour Ensuring Likeness, Voice, and Image Security Act – Loi sur la sécurité de l’image, de la voix et de la ressemblance), l’État interdit notamment que les outils d’IA générative clonent la voix d’un artiste sans son consentement. Même principe en Europe: entré en vigueur le 1er août, le Règlement européen sur l’intelligence artificielle (AI Act) oblige les fournisseurs à détailler à ses utilisateurs le contenu utilisé pour nourrir son moteur. Un contenu qui, hormis pour la recherche scientifique, ne pourra de toute façon être alimenté que si les auteurs concernés ne s’y opposent pas.

Nouvelles frontières

Face à la montée de l’IA, tous les artistes ne sont toutefois pas aussi inquiets. Férue d’électronique, titulaire d’un doctorat de l’Université de Stanford, la compositrice américaine expérimentale Holly Herndon a mis au point son propre deepfake, baptisé Holly+. Pour le coup, l’intelligence artificielle a pu bénéficier d’heures entières d’enregistrement de la voix de Herndon, aussi bien parlée que chantée. De quoi confectionner un outil particulièrement performant. Pour l’instant, Holly+ est mis à disposition du public gratuitement. Une manière d’à la fois contrôler l’outil et d’en faire la promo. Holly Herndon n’a cependant pas abandonné l’idée de monétiser cet outil.

En 2018, sortait également Hello World. Présenté comme le premier album entièrement généré par l’IA, il était crédité sous le nom de SKYGGE (« ombre », en danois). Derrière le projet, on trouvait le scientifique français François Pachet -aujourd’hui directeur du labo de recherche de Spotify-, et le chanteur-compositeur Benoît Carré -membre du groupe Lilicub dans les années 90 (le tube Voyage en Italie), qui a notamment travaillé pour Françoise Hardy, Maurane, Johnny Hallyday… C’était déjà le même duo qui avait commis le Daddy’s Car « à la manière des Beatles ». Avec Hello World, il a franchi un pas supplémentaire (avec l’aide d’autres artistes, dont un certain Stromae…). Face aux angoisses de nombre de ses collègues, Benoît Carré veut tranquilliser: « Il faut malgré tout nourrir la machine, sinon c’est un système d’apprentissage vide », explique-t-il dans une conférence TEDx, visible sur YouTube. La technologie permet d’ouvrir des pistes musicales, de créer de nouveaux horizons, d’amener des « dérapages » stimulants. Mais ne peut toujours pas se passer d’une intervention humaine. En d’autres mots, pour Benoît Carré, l’IA est un instrument comme un autre.

D’une certaine manière, c’est également le discours d’une mégastar comme David Guetta. En 2023, le DJ français balançait par exemple sur scène un morceau inédit, sur lequel on pouvait entendre la voix d’Eminem. Sauf que le rappeur n’avait évidemment jamais écrit et prononcé « This is the future rave sound « ! C’est ChatGPT qui a pondu le texte, et Uberduck qui a singé la voix. Une blague qui a bien fait marrer Guetta. « Je voulais juste montrer à quel point, techniquement, ce qui se passait était intéressant », confiait-il au magazine Rolling Stone. Pour le DJ, l’IA est un nouvel outil aussi excitant qu’inévitable. Un instrument, dont l’efficacité dépend avant tout de la manière dont l’humain va le nourrir. « Si vous avez des goûts horribles, votre musique continuera d’être horrible, même avec l’IA. » D’aucuns diront que David Guetta est bien placé pour le savoir…

Malgré ces discours rassurants, l’intelligence artificielle n’a pas encore convaincu tout le monde. C’est le moins que l’on puisse dire. Pour cause, les compositeurs de musiques instrumentales d’accompagnement (pour des films, pubs, documentaires, podcasts, bibliothèques sonores, etc.) voient déjà leurs revenus fondre. Une tendance qui devrait non seulement se renforcer mais aussi toucher de plus en plus de créateurs. Publié début décembre, un rapport de la CISAC (la Confédération internationale des sociétés d’auteurs et compositeurs, représentant plus de 5 millions de créateurs de musique et d’audiovisuel dans le monde) prévoyait une chute de revenus du secteur de quelque 24 %. Dans le même temps, les revenus des services d’IA générative devraient passer de 3 milliards à 64 milliards d’euros d’ici à 2028.